今回のテーマは「AIの問題点」についてです。

AIに問題点なんてあるんですか?

目次

AI(人工知能)とは

AI(人工知能)とは、Artificial Intelligence(アーティフィシャル・インテリジェンス)の略で、人が実現するさまざまな知的な活動を行うプログラムやシステムのことです。

コンピュータの性能が大きく向上したことにより、機械であるコンピュータが「学ぶ」ことができるようになりました。

身近な例では、SiriやGoogle Assistant、Alexaなどの音声アシスタントや、お掃除ロボットなどがあります。

AI(人工知能)を支える基礎技術には「機械学習」や「ディープラーニング」があり、これらを土台として画像認識や動画認識、音声認識、自然言語処理などの応用技術が発展しています。

本記事では、AI(人工知能)の問題点について紹介しています。

スポンサーリンク

AI(人工知能)の問題点

AIはさまざまな分野で社会的課題が解決できると期待が高まっていますが、AIは大量データから学習するので、学習データに誤った情報や偏った情報があると、必ずしも正しい情報が得られるとは限りません。

発展途中の技術のため、AIに頼りすぎると、機器情報や個人情報の漏洩、人権の侵害、プライバシーの侵害など、さまざまな課題や問題が発生する可能性があります。

また、AIが悪用されるかもしれません。そのため、各分野において法整備やルール作りなどが必要になっています。

ディープフェイク

ディープフェイクとは、「ディープラーニング」と「フェイク」を組み合わせた造語で、AIを用いて生成された偽の画像や映像、音声、またはそれらを生成する技術のことです。

ディープフェイクを巧妙な騙しの手口として悪用する犯罪が増えています。映像だけでなく音声も偽装可能なので、企業の経営者などになりすまし、実際には言っていないことを言わせることも可能です。

SNSの発展により、個人が自由に発信できる時代です。嘘偽の情報に騙されないように、ディープフェイクを見破るなどの対策が必要です。

映像や音声の出所を確認し、信頼できる情報源かどうかを検証する習慣を身につけることが重要です。

また、ディープフェイクを探知するツールなどを活用するのもいいでしょう。

人間中心のAI社会原則

人間中心のAI社会原則とは、政府が策定したもので、次の3つを基本理念としています。

- 人間の尊厳が尊重される社会(Dignity)

- 多様な背景を持つ人々が多様な幸せを追求できる社会(Diversity & Inclusion)

- 持続性ある社会(Sustainability)

さらに人々が安心してAIを使用できるように、以下の7つの原則を定めています。

| ① 人間中心の原則 | AI の利用は、憲法及び国際的な規範の保障する基本的人権を侵すものであってはならない。 AI の利用がもたらす結果については、問題の特性に応じて、AIの開発・提供・利用に関わった関係者が適切に分担して責任を負うべきである。 |

| ② 教育・リテラシーの原則 | AIの利活用に関する教育・リテラシーを育む教育環境が全ての人に平等に提供されなければならない。 |

| ③ プライバシー確保の原則 | パーソナルデータ(個人に関連する様々な情報)は、その重要性・要配慮性に応じて適切な保護がなされなければならない。 |

| ④ セキュリティ確保の原則 | 社会は、常にベネフィット(顧客が得る利益)とリスクのバランスに留意し、全体として社会の安全性及び持続可能性が向上するように務めなければならない。 |

| ⑤ 公正競争確保の原則 | 新たなビジネス、サービスを創出し、持続的な経済成長の維持と社会課題の解決策が提示されるよう、公正な競争環境が維持されなければならない。 |

| ⑥ 公平性、説明責任及び透明性の原則 | AI の利用によって、人々が、その人の持つ背景によって不当な差別を受けたり、人間の尊厳に照らして不当な扱いを受けたりすることがないように、公平性及び透明性のある意思決定とその結果に対する説明責任が適切に確保されると共に、技術に対する信頼性が担保される必要がある。 |

| ⑦ イノベーションの原則 | AI の発展によって、人も併せて進化していくような継続的なイノベーションを目指すため、国境や産学官民、人種、性別、国籍、年齢、政治的信念、宗教等の垣根を越えて、幅広い知識、視点、発想等に基づき、人材・研究の両面から、徹底的な国際化・多様化と産学官民連携を推進するべきである。 |

AI活用ガイドライン

AI活動ガイドラインとは、AIを安全かつ効果的に利用するための指針であり、主にAIサービスを提供する事業者に向けたものです。

AI活動ガイドラインは、以下の10原則で構成されています。

| ① 適正利用 | 人間とAIを適正に役割分担し、適正な範囲及び方法でAIを利用する。 |

| ② 適正学習 | AIシステムの学習等に用いるデータの質に留意する。 |

| ③ 連携 | AIシステム相互間の連携と、連携によるリスクの増幅に留意する。 |

| ④ 安全 | 利用者及び第三者の生命・身体・財産に危害を及ぼすことがないよう配慮する。 |

| ⑤ セキュリティ | AIシステムのセキュリティに留意する。 |

| ⑥ プライバシー | AIシステムの利活用において、他者又は自己のプライバシーが侵害されないよう配慮する。 |

| ⑦ 尊厳・自律 | 利用者は、AI システムの利活用において、人間の尊厳と個人の自律を尊重する。 |

| ⑧ 公平性 | AI システムの判断によって個人が不当に差別されないよう配慮する。 |

| ⑨ 透明性 | AIシステムの入出力等の検証可能性及び判断結果の説明可能性に留意する。 |

| ⑩ アカウンタビリティ | ステークホルダに対し説明責任を果たすよう努める。 |

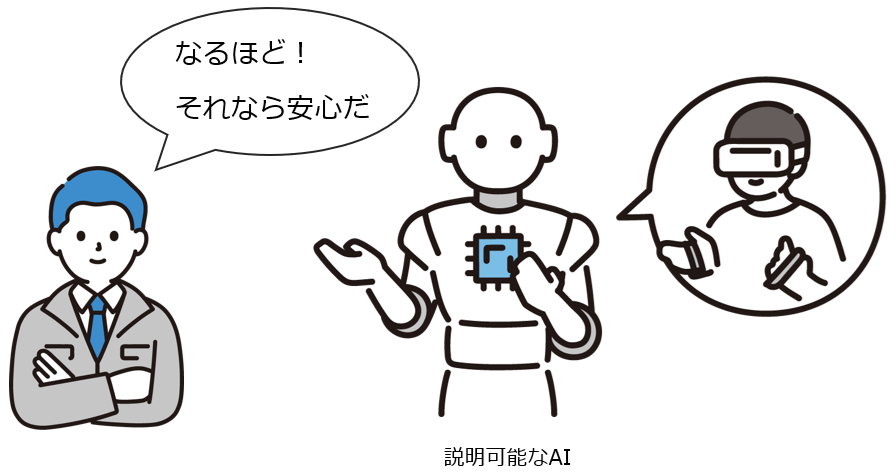

説明可能なAI

AIが導き出した答えについて、なぜその答えを出したのか、人が理解できるようにすることが重要です。この能力が高いAIのことを「説明可能なAI」といいます。

人が理解できるように説明することで、AIの信頼性や透明性が高まり、AIの活用促進につながります。

スポンサーリンク

練習問題

ITパスポート令和6年 問12

AIに関するガイドラインの一つである"人間中心のAI社会原則"に定められている七つの"AI社会原則"のうち、"イノベーションの原則"に関する記述として、最も適切なものはどれか、ア~エを順番に確認していきます。

ア:AIの発展によって人も併せて進化するように,国際化や多様化を推進し,大学,研究機関,企業など,官民における連携と,柔軟な人材の移動を促進する。

正解:イノベーションの原則に関する記述です。

イ:AIの利用がもたらす結果については,問題の特性に応じて,AIの開発,提供,利用に携わった関係者が分担して責任を負う。

不正解:人間中心の原則に関する記述です。

ウ:サービスの提供者は,AIを利用している事実やデータの取得方法や使用方法,結果の適切性について,利用者に対する適切な説明を行う。

不正解:公平性、説明責任及び透明性の原則に関する記述です。

エ:情報弱者を生み出さないために,幼児教育や初等中等教育において,AI活用や情報リテラシーに関する教育を行う。

不正解:教育・リテラシーの原則に関する記述です。

「ア」が正解です。

ITパスポートおすすめの参考書・問題集

| いちばんやさしい ITパスポート | 試験に合格することを目的に企画・構成された対策本。ITの知識がまったくない、未経験者やでもスラスラと学習を進められるよう、丁寧に解説。 |

| ITパスポート超効率の教科書 | スキマ時間で効率的にITパスポートの試験対策ができる対策本。動画とテキスト、小テストと過去問を組み合わせた、効果的な4ステップ学習で、合格へと導く。 |

| かやのき先生のITパスポート教室 | ITパスポート受験者のためのやさしいオールインワンタイプの参考書&問題集。イラストや豊富な図解・例え話を駆使して理解しやすく・記憶に残りやすいように説明。 |

| かんたん合格ITパスポート過去問題集 | 信頼と実績の過去問題集。ITパスポート試験合格を最短で目指す人は必携の1冊! |

| 出るとこだけ!ITパスポート | 「ITパスポート」に効率よく合格したい人のため対策本。フルカラーで見やすく「出るとこだけ」を効率的に学習できる1冊! |

| キタミ式イラストIT塾 ITパスポート | すべての解説をイラストベースで行っているため,とてもわかりやすい解説本。いちばん最初に読むITパスポート試験関連の書籍を探している人におすすめ! |